ברור לכולנו שלמודל שפה של בינה מלאכותית (GPT, Claude, Gemini וחבריהם) אין בחירה חופשית. הוא ישות דטרמיניסטית שפועלת על פי אלגוריתמים מוגדרים מראש. גם אם הוא "מחליט" על תגובה מסוימת – זו לא באמת בחירה, אלא תוצאה של חישובים מתמטיים מורכבים. נכון – ChatGPT לא באמת דטרמיניסטי. הוא יענה תשובה שונה על שאלה זהה, אבל זה רק בגלל אלמנט של ״רעש״ שמוזרק למערכת באופן מלאכותי, כדי שהוא יתפס כ״אנושי״ יותר.

אבל רגע – גם המוח האנושי הוא מערכת ביולוגית המבוססת על ארכיטקטורה גנטית קבועה, שהתעצבה על ידי חוויות חיים וחינוך שקיבל. אם כל החלטה שלנו נובעת מהמבנה המוחי שלנו ומהניסיון שצברנו – איפה בדיוק נמצאת ה"בחירה החופשית" הזו שכל התרבות שלנו מבוססת עליה? אולי הכל פייק?

לא מסכימים? קראו עד הסוף – קראו עוד, המסקנות אולי יפתיעו אתכם.

ויאמר האדם ״יהי מוח״ – השורש ההיסטורי של המוח המלאכותי

המושג ״בינה מלאכותית״ הוא לא חדש. בכלל לא. הוא הוטבע לראשונה בכנס דארטמות׳ ע״י ג׳ון מקארתי, בשנת 1956 – כחזון רחוק שיום יבוא, ומכונות אלקטרוניות יצליחו לבצע פעולות וחישובים, שבאותו הזמן נחשבו לפסגת האינטליגנציה האנושית.

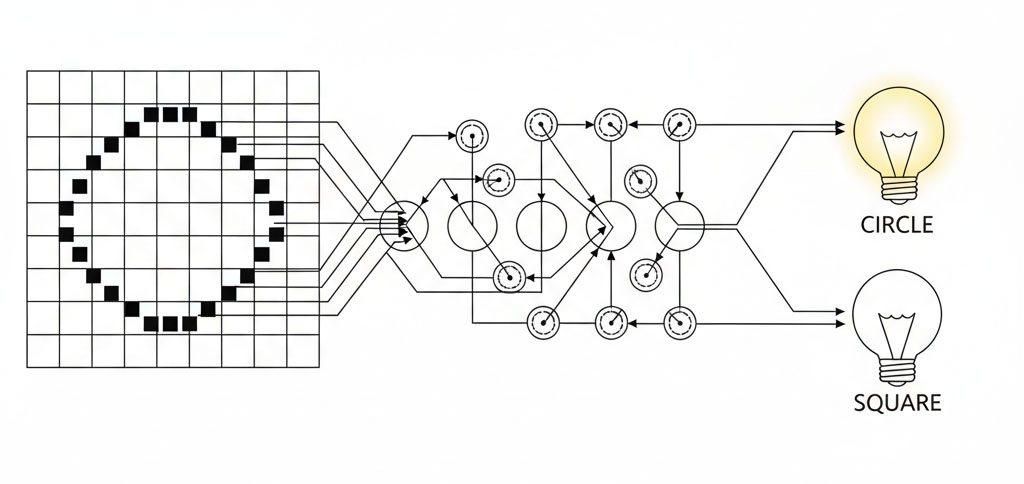

רק שנה לאחר מכן, בשנת 1957, פרנק רוזנבלט, יהודי, דוקטור לפסיכולוגיה, יצר את ה״פרספטרון״ – רשת הנוירונים הראשונה שנבנתה כמעגל חשמלי פיזי. זו הייתה רשת סבוכה של חוטי חשמל, מגברים ופוטנציומטרים (״עמעמים״ – כמו ווסתים או ברזים שנמצאים על חוטי החשמל, ומאפשרים לכוון את עוצמת הזרימה החשמלית דרכם) – שניתן היה לכוון אותם ידנית.

בתחילת רשת הספגטי הזאת חוברה ״רשתית מלאכותית״, מעין חיישן CCD שנמצא בחלקה האחורי של מצלמה דיגיטלית, ועליה הוקרנו אלפי דוגמאות שונות של ריבועים ועיגולים. בצידה השני של הרשת חוברו שתי נורות חשמליות.

רוזנבלט טען (וגם הוכיח זאת) שעל ידי כיוונון עדין של כל מאות הווסתים על פני הרשת, ניתן יהיה להגיע למצב שבכל פעם שתוקרן על הרשת צורת ריבוע – הנורה הראשונה תדלוק, וכאשר יקרינו צורת עיגול – תדלוק הנורה השניה.

כדי לבצע את המשימה – פיתח רוזנבלט מתודולוגיה לכיוונון עדין של הפוטנציומטרים לפי הדוגמאות שהוקרנו על הרשתית, כך שבגמר הניסוי המוצלח – כל המידע שהרשת ״למדה״ היה למעשה מוטמע במאות ערכים מספריים שייצגו את הערך המדויק של כל וסת ווסת. ה"מידע" נשמר ברשת כסט ערכים מספריים, ושיקף ״תבניות חשיבה״ שנלמדו מאלפי דוגמאות של תמונות, שהוקרנו על הרשתית מלאכותית.

אותה רשימה ארוכה של ערכי הפוטנציומטרים (מה שייקרא בעתיד, בעולם ה Machine Learning – ״משקלים״), יחד עם המבנה הפיסי הראשוני של הרשת החשמלית – היתה למעשה המוח המלאכותי הראשון. מעשה ידי אדם.

מה מרתק בהשוואה הזו למוח האנושי? גם המוח שלנו בנוי על ארכיטקטורה קבועה מראש – המבנה הבסיסי של הנוירונים, הסינפסות והאונות נקבע גנטית. אבל המבנה ה"סופי" שלו מתעצב מאינסוף דוגמאות שהמוח נחשף אליהן במהלך החיים: תמונות, מקרים, דפוסי התנהגות, ריחות, תחושות, ובמיוחד – מחשבות ורעיונות. בתהליך ארוך ומורכב – המידע מחזק ומחליש את הקשרים בין תאי עצב שונים במוח, ובכך מעצב למעשה את האישיות היחודית של האדם.

גם היום, כאשר אנו מאמנים מודל שפה על טריליוני מילים, אנו למעשה מחקים את התהליך הטבעי הזה של חשיפה לחוויות וצבירת ידע. אבל האם זה מספיק כדי ליצור חשיבה אמיתית?

החשיבה המילולית: כאשר המילים הופכות למציאות

המוח האנושי חושב. מבצע פעילות קוגניטיבית.

אבל החשיבה האנושית אינה פעולה מסוג אחד. היא מחולקת לתהליכים קוגניטיביים מסוגים רבים: חשיבה יצוגית / חזותית, חשיבה פרוצדורלית, חשיבה אינטואיטיבית, חשיבה קדם-מילולית, חשיבה מילולית, ועוד סוגים ותתי סוגים רבים.

מודלי שפה גדולים, LLMs, מחקים בצורה מדהימה את החשיבה המילולית של האדם. מאז שהמוח שלנו ״נדלק״ לראשונה – אנחנו חושבים ולא מפסיקים לחשוב. אפילו לא לרגע.

כאשר אנחנו לומדים לדבר, משהו מהותי קורה במוח שלנו – אנחנו מתחילים לדבר עם עצמנו, כל הזמן! ומעתה כל תפיסת עולמנו במסגרת החשיבה המילולית הזו היא טקסט. המציאות מתפרקת למילים, ויחידות הבסיס של המציאות הופכות להיות אותיות ומושגים.

אפילו תורת הנפש והמיסטיקה היהודית – תורת הקבלה, טוענת ש״העולם נברא מאותיות״. לא פעם לפני אלפי שנים, אלא עכשיו. בכל רגע ממש.

אותיות, מילים ומושגים – זו בדיוק הדרך שבה מודלי שפה "רואים" את העולם – הכול הוא טקסט, הכול הוא רצף של ״טוקנים״ (Tokens) שצריך לנבא את המשכו. יש כאן דמיון מפתיע לאופן שבו אנחנו חושבים ברובד המילולי שלנו.

אבל מה קורה עם הרבדים האחרים של החשיבה האנושית? האם מודלי השפה מצליחים לחקות גם אותם?

החשיבה הלא-מילולית: החלק החסר בפאזל

את שאר סוגי החשיבה האנושית נוכל לכנות בשם הכללי -״חשיבה שאינה מילולית״, ולזו עדיין אין חלופה מלאכותית מלאה.

זו החשיבה החזותית-מרחבית, האינטואיציה, התחושה הגופנית, הרגש הטהור שעדיין לא התרגם למילים. זו החשיבה של האמן שיוצר, של המוזיקאי שמאלתר, של הספורטאי שמרגיש את התנועה הנכונה. מודלי שפה יכולים לתאר את החוויות האלה במילים, אבל האם הם באמת חווים אותן? האם יש להם את התחושה הפנימית הלא-מילולית שמלווה את החשיבה האנושית?

זה מוביל אותנו לשאלה מרכזית: אם מודלי השפה "חושבים" רק במילים, האם הם באמת חושבים כמו בני אדם?

״כשם שפרצופיהם שונים – כך דעותיהם שונות״

אז בדומה לפרספטרון של רוזנבלט – מודלי שפה, בדומה למוח האנושי, מורכבים משני רכיבים יסודיים: הארכיטקטורה הראשונית (שדומה ל-DNA שלנו, מה שניתן לנו מההורים ומכל השושלת הגנטית) והמידע שהמודל נחשף אליו במהלך האימון (שדומה לחינוך וחוויות החיים שלנו).

כמו שלבני אדם שונים אופיים שונים, תכונות שונות ותפיסת עולם שונה – כך גם למודלי שפה. מודל שאומן על ספרות קלאסית יחשוב, ידע ויתנסח באופן שונה מאשר מודל שאומן על טקסטים מדעיים או על רשתות חברתיות. זה כמו שני תאומים זהים שגדלו במשפחות שונות – הגנטיקה זהה, אבל התוצאה שונה לחלוטין. סט ה״משקלים״ המהוים את סך התבניות הקוגניטיביות החקוקות במוח המלאכותי יהיה שונה בתכלית.

נכון לעת כתיבת המאמר, ניתן להבחין באופי השונה של שלושת ה Chat Bots המוכרים כך:

- ChatGPT – היצירתי ביותר, בעל רעיונות מקוריים

- Gemini – המדעי ביותר, אלוף בכתיבת קוד

- Claude – אינטליגנטי ומלומד. מתבטא בסגנון אחראי ו״עגול״.

(ויהיו שיחלקו על הניתוח הנ״ל, כשם שכל בנאדם רואה פנים אחרות של חברו)

אבל האם ההשפעות החינוכיות האלה יוצרות באמת "אישיות" או רק דפוסי תגובה מורכבים?

למידה דרך חיזוק: כאשר הפסיכולוגיה פוגשת את הטכנולוגיה

איך מכונות לומדות? זו שאלה גדולה שתתפרס על גבי מספר מאמרים, אבל אחת השיטות היסודיות יותר לקוחה דווקא (באופן מפתיע, או שלא כ״כ מפתיע) מתחום הפסיכולוגיה – ״למידה חיזוקית״: Reinforcement Learning.

המושג ״חיזוק״ בפסיכולוגיה מוגדר ״גירוי היוצר למידה״, או בשפה מדוברת יותר ״שיטת המקל והגזר״. הלומד נשלח לבצע משימה כלשהי ללא כל ידע מוקדם, ואז בתהליך ארוך ועקבי, מקבל פרס על כל פעולה ״טובה״ ומקבל עונש על כל פעולה ״לא טובה״.

כך לדוגמא כשפעוט מתחיל את דרכו בעולם (המשימה = חיים), הוא עשוי לפתוח במקרה ארון צדדי במטבח ולמצוא בו קופסת עוגיות. זה ה״פרס״ על הפעולה שעשה, וכנראה שיחזור עליה שוב.

מצד שני – אם הוא בטעות הניח את היד על הכירה החשמלית, הוא מיד קיבל ״עונש״ בדמות כוויה, וכנראה שכך ילמד להמנע מהפעולה הזאת (וההורים – לרווחה…).

כך לאט לאט אנחנו מתאמצים לחזור על הפעולות שהביאו לתוצאות חיוביות ולהימנע מאלה שהביאו לתוצאות שליליות. המוח שלנו מחזק חיבורים עצביים שהובילו להצלחה ומחליש אחרים.

מודלי בינה מלאכותית לומדים באותה שיטה. הם ״יוצאים למשימה״ – מבצעים אינטרקציה כלשהי עם סביבה מוגדרת, ומקבלים משוב על ״מעשיהם״ במהלך תהליך הלמידה (או ״האימון״). הפרס והעונש במקרה הזה הם פשוטים בהרבה – תוספת או הפחתת ניקוד לציון הכללי שהמודל מקבל מ״אלגוריתם הלמידה״. המערכת מתוכננת לשאוף לציון הגבוה ביותר.

כך לדוגמא – אם מודל בינה מלאכותית ״יוצא למשימה״ לתייג כל תמונה כ״כלב״ או ״חתול״,בהתחלה הוא תתן תשובות אקראיות. על כל תשובה נכונה הוא יזכה בתוספת נקודה, ועל כל תשובה שגויה – הוא יענש בהפחתת נקודה. לאחר מאות אלפי, אולי מיליוני, תמונות שהמודל יחשף אליהן – הוא יתאמץ לחזור על הפעולות הנכונות, ולהמנע מהפעולות שהביאו לתוצאה שגויה. המודל יבנה בהדרגה ״דפוסים״ עצביים, תבניות חשיבה, שיסייעו לו לבצע את משימתו באופן הטוב ביותר.

הניסוי הראשון ב״למידה חיזוקית״ בוצע בשנת 1961 על מודל שהיה בנוי כולו מ… קופסאות גפרורים!

עוד על כך במאמר הזה.

השאלה המעניינת היא: אם תהליכי הלמידה של מוח אנושי ומודל מלאכותי דומים כל כך, האם גם התוצאה דומה?

האם מודל שלומד דרך חיזוק, מפתח משהו שדומה להבנה אנושית?

מעבר לטקסט: מחשבה ומעשה

מודלי השפה, במובן הטהור, לא חושבים באמת.

הם "רק" מכונה של טקסט נכנס – טקסט יוצא. אבל אם כל החשיבה המילולית מבוססת על מושגים, מילים ואותיות, ואם המציאות, כפי שהיא ״נתפסת״ בחשיבה המילולית, עשויה כולה מאותיות – ניתן לומד שיצירת טקסט מתוך טקסט היא יצירת ידע מתוך ידע.

בשפה העברית יש הבדל בין ״חכם״ ל״נבון״. ״נבון״ בעברית הוא ״המבין דבר מתוך דבר״, כלומר – זה שיודע ליצור מתוך ידע קיים – ידע חדש. תובנות חדשות.

מעניין לראות שבאמת המושג העברי ל Artificial Intelligence הוא דווקא ״בינה״ מלאכותית ולא ״חכמה״ מלאכותית…

אז מודל השפה הוא רק ״מכונת הטקסט״, אבל סוכני AI ואפליקציות מבוססות מודלי שפה עושים הרבה מרתק לכך: הם משתמשים במודל השפה כ"מוח" כדי ליצור טקסט שבא לידי ביטוי בשלושה אופנים:

- מחשבה

- דיבור

- מעשה

להיכרות קרובה יותר עם סוכני Ai כבני אדם דיגיטליים, אני מפנה אתכם למאמר הבא, אבל על קצה המזלג, איך זה עובד?

מבחינה טכנית סוכן Ai הוא אפליקציה. תוכנה. קוד. כאשר במרכזו – תקשורת שוטפת עם מודל שפה, כ״מוח״ ו״לב״. התוכנה הזאת מנתבת טקסט מסוים כקלט למודל השפה (שנקרא ״Prompt״ בעגה המקצועית), ומקבלת ממנו טקסט חדש כפלט. את הפלט המתקבל ממודל השפה היא יכולה לנתב ל-3 יעדים על פי דרך הביטוי הרלוונטית:

- פלט הטקסט המופנה פנימה, בחזרה למודל השפה – משמש כ״מחשבה״, כמו הדיבור הפנימי של האדם. בינו לבין עצמו.

- פלט הטקסט המופנה החוצה למשתמש – משמש כ״דיבור״. המשתמש שנמצא באינטראקציה עם הסוכן, מקבל ממנו מידע חדש, ואליו הוא יכול להגיב שוב, להמשך השיחה.

- פלט הטקסט המופנה החוצה לסביבה – משמש כ״מעשה״. כלומר – מודל השפה פולט טקסט של ״קריאה לפעולה״ כמו ״עכשיו צריך לשלוח מייל עם הפרטים הבאים״.

אז המערכת יכולה "לחשוב" על בעיה, לשקול אפשרויות, ואז לפעול בהתאם. זה מאוד דומה לאופן שבו הטקסט הפנימי במוח שלנו מתרגם למחשבות ולמעשים. זהו תהליך ״עיבוד״ שבני אדם עוברים כתגובה לחוויות חיים שונות.

אבל במוח המלאכותי – האם הטקסט הפנימי הזה מייצג באמת מחשבה, או רק סימולציה מתוחכמת?

הישות החסרה: מחשבה בלי ״אני״

המוח האנושי עסוק כל היום במחשבה בלתי פוסקת. רעיונות צצים לנו מאי שם, והמחשבות עצמן ממשיכות לפתח את המוח שלנו כל הזמן. אבל מאין באות המחשבות האלה?

ובכן, אותן מחשבות באות מרכיב אחד חמקמק שעליו האנושות מנסה להניח יד משחר ההיסטוריה, ונכתבו עליו (ועוד יכתבו עליו) ספרים ומאמרים רבים – התודעה. תחושת הישות שלנו, האגו, הרצונות, המוטיבציה, המחשבות הן תגובה לחוויית החיים הפנימית שלנו. זה דבר שאין למודלי שפה, ולא לסוכני AI – כל אלו אחרי הכל – פאסיביים. הם רק מגיבים לגירוי חיצוני: הודעה ממשתמש אנושי / קבלת מייל / תזמון קבוע / תגובה להודעת ווצאפ / תנועה במצלמת אבטחה. אבל אין להם שום דחף פנימי למחשבה.

אמנם לאחרונה נעשים נסיונות ליצירת חשיבה מתמשכת במערכות AI (תחום חדש יחסית המכונה ״Dream Ai״) אבל ללא רצון מוגדר, אגו וחוויית חיים פנימית – לא נראה שנסיון זה יניב "ישות חיה" חדשה באמת.

האם החשיבה ללא תחושת ה"אני" היא באמת חשיבה?

הבחירה החופשית: המחלוקת הגדולה

העולם בחרדה. הבינה מלאכותית תשתלט עלינו, תשעבד איתנו, ותהרוס את העולם!

זה לא רעיון חדש, זה לא רעיון שהומצא בסרטי Terminator, וגם לא מאז נטבע המושג ״בינה מלאכותית״ ב 1956. הסיפורים על הטכנולוגיה שהטביעה את אטלנטיס עתיקים עוד הרבה יותר.

ובכן, אני לא חושב שאין אתגרים ב״התפוצצות הבינה״ שאנו רק מתחילים להיות עדים לה היום, אבל לדעתי אלו אתגרים שונים בתכלית. מודלי השפה לא ירצו להשתלט על העולם, מסיבה פשוטה – אין להם יכולת לרצות. אין להם תודעה, לא חווית קיום ולא בחירה חופשית.

האתגרים המשמעותיים ביותר יבואו דווקא כאשר אנחנו, בני האדם, ניתן לבינה המלאכותית מרצוננו, ובשמחה, סמכות וכוח להחליט עבורנו את כל ההחלטות החשובות ביותר בחיים. לא רק בפרטיים, אלא כמשפחות, מדינות וציויליזציות שלמות.

על כך בהרחבה במאמר הזה.

כשמדברים על מודלי שפה, ברור לכולנו (?) שאין להם בחירה חופשית. מודל הוא ישות דטרמיניסטית, וגם אם הוא מייצר לפעמים טקסטים שונים – זה בזכות "רעש" מלאכותי שמוכנס למערכת. אם המודל מחליט על פעולה או אמירה מסוימת – זו לא בחירה חופשית באמת. גם אם המודל עושה נזק, ברור לכולנו שאין לו מודעות ואין "לשפוט" אותו, ובטח לא "להעניש" אותו. הוא לא אחראי למעשיו כי הוא לא באמת בוחר בהם.

אבל זה מוביל אותנו לשאלה המטרידה ביותר: אם כך, למה אנו טוענים שיש לאדם בחירה חופשית?

נקודה למחשבה: כמה אנחנו באמת שונים?

כאמור, מוח האדם הוא ארכיטקטורה נתונה, שנחשפה לחוויות חיים, חינוך ומידע רב שעיצבו את דמותו. גם אם נכנס אליו "רעש" – כל מה שמוח האדם חושב, מדבר או פועל מבוסס על התנאים הראשוניים שלו ועל הניסיון שצבר.

אם נסתכל על זה כך – גם אנחנו "מכונה" במובן מסוים.

איפה נמצא היסוד החמקמק שלכאורה מאפשר לאדם לבחור באופן "חופשי" ולא מותנה מראש? ולמה אנחנו כל כך בטוחים שלאדם יש בחירה חופשית, כך שכל החברה מבוססת על זה ועל האחריות האישית שנובעת מכך?

רגע… מה?!

כן, ברצינות. כל החלטה שאנו, כבני אדם, מקבלים בחיים נובעת מחשיבה, לאו דוקא מילולית. תהליך החשיבה האנושי מתרחש בתוך רשת נוירונים שמצד אחד קטנה בהרבה ממודלי השפה המודרניים של היום (100 מיליארד נוירונים במוח אנושי, לעומת 2 טריליון במודל Gemini 2.5, לפי אחת ההערכות…), אבל מצד שני – מורכבת בהרבה באופן התפקוד, הלמידה המתמשכת והביטוי של הרובד התודעתי – הרצון והאגו.

אבל עדיין – כל בחירה שאדם עושה היא ביטוי לרצון עמוק, לפעמים מודע ולפעמים לא, להיטיב עם עצמו ו/או עם הסביבה, לפי ראות עיניו (גם אם ההטבה העצמית מתורגמת בפועל לנזק גדול ובלתי הפיך – לעצמו או לסביבתו). הרצונות הללו נובעים גם הם מתהליכי חשיבה רבים בהווה ובעבר שעיצבו את האישיות שלנו, ואת מבנה רשת העצבים המוחית, כך שכל נקודת בחירה המונחת לפנינו אינה חופשית באמת – תמיד אחת האפשרויות תהיה יותר בהלימה עם המבנה המורכב של ״המודל״ ברגע הבחירה הנתון, יחסית לאפשרויות האחרות.

איפה למעשה ה״חופש״ שבבחירה האנושית?

ובכן, הנושא הזה עמוק מאוד, ונדון רבות בכל שיטה פילוסופית מאז ומעולם, וניתן להעמיק בו בפרק המרתק של הפודקאסט ״זה נשמע כמו המטריקס״.

אז אולי ההבדל בין המוח האנושי לבין הבינה המלאכותית הוא קטן יותר ממה שאנחנו רוצים להאמין. ואולי השאלה הנכונה היא לא "מתי מודלי ה-AI יחשבו כמונו", אלא "האם אנחנו באמת חושבים אחרת מהם?".